L’IA au croisement du RGPD et du reglement europeen sur l’IA

L’intelligence artificielle pose des defis majeurs en matiere de protection des donnees personnelles. L’entrainement des modeles d’IA necessite generalement de grandes quantites de donnees, dont une part significative peut constituer des donnees personnelles. Le RGPD s’applique pleinement a ces traitements, en complement du reglement europeen sur l’intelligence artificielle (AI Act) entre en vigueur en 2024.

La CNIL a publie plusieurs recommandations sur l’articulation entre IA et RGPD. Elle souligne que le developpement de l’IA ne doit pas se faire au detriment des droits fondamentaux des personnes et que les principes du RGPD restent pleinement applicables aux traitements fondes sur l’IA.

La base legale pour l’entrainement des modeles d’IA

La determination de la base legale pour l’entrainement des modeles d’IA est un enjeu central. Le consentement est difficilement applicable compte tenu du volume de donnees necessaires. L’interet legitime est la base legale la plus frequemment invoquee, mais elle necessite une mise en balance rigoureuse entre les interets du responsable de traitement et les droits des personnes concernees.

La CNIL recommande que la mise en balance prenne en compte la nature des donnees utilisees (donnees publiques ou privees), les attentes raisonnables des personnes concernees, les mesures de minimisation et de pseudonymisation mises en oeuvre, et les garanties offertes pour l’exercice des droits des personnes.

Le respect des principes du RGPD dans les systemes d’IA

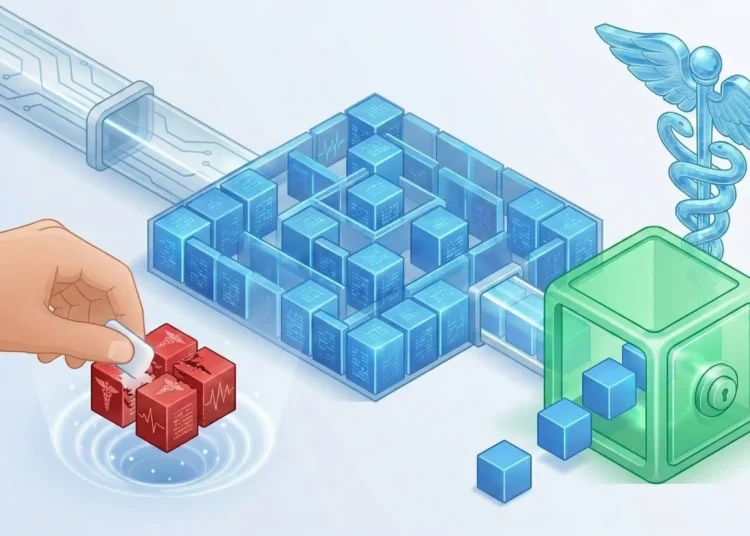

Le principe de minimisation des donnees est particulierement difficile a appliquer dans le contexte de l’IA, ou la performance des modeles est generalement correle au volume de donnees d’entrainement. Le responsable de traitement doit neanmoins demontrer que les donnees utilisees sont adequates, pertinentes et limitees a ce qui est necessaire.

Le principe de transparence impose d’informer les personnes concernees de l’utilisation de leurs donnees pour l’entrainement de modeles d’IA. Lorsque les donnees sont collectees directement aupres des personnes, cette information doit etre fournie au moment de la collecte. Lorsque les donnees sont obtenues de maniere indirecte (scraping web), l’information peut s’averer plus complexe a delivrer.

Le droit d’opposition doit pouvoir etre exerce de maniere effective. La CNIL insiste sur la mise a disposition de mecanismes simples permettant aux personnes de s’opposer a l’utilisation de leurs donnees pour l’entrainement de l’IA, y compris via des protocoles techniques comme le robots.txt ou des balises meta specifiques.

L’AIPD, un prealable indispensable

La plupart des traitements d’IA impliquant des donnees personnelles necessitent une analyse d’impact prealable. Le profilage, la prise de decision automatisee, le traitement a grande echelle et l’usage innovant de technologies constituent autant de criteres qui declenchent l’obligation de realiser une AIPD.

L’AIPD doit evaluer les risques specifiques lies a l’IA : biais algorithmiques, discrimination, opacite des decisions, reutilisation non prevue des modeles. Les mesures de traitement de ces risques incluent l’audit des modeles, les tests de biais, l’explicabilite des decisions et la supervision humaine des processus automatises.